快訊

- 川習會MSCI季調登場 台股四萬二壓力測試、進入高檔整理

- 逾10萬公里折返跑 史國副總理杜札莉昨飛第四趟離台

- 為川習會暖身 美中財經首長週三將在南韓會晤

- 印尼在唐人街旁破獲史上最大非法網路賭博組織 逮捕逾300名外籍人士

- 北市知名產後護理之家疑涉裝偷拍設備 負責人喊冤:無功能廢線

- 快訊/伊朗已經向美國回答和談提議 以「停止戰爭」為核心

- 日經:日廠與台灣密切合作無人機 擺脫「紅色供應鏈」

- 伊朗沒在管停火 攻擊轟炸科威特、擊傷阿布達比出航的貨輪

- 中共民族團結進步促進法7月上路 羅文嘉分析:中華民族將等同中共專政

- 從美國副總統到國務卿都見了! 卡達超密集斡旋伊朗問題、天然氣輪首獲伊朗放行

- 「藍白做球讓習近平殺」!川習會前大砍軍購4700億 美國恐懷疑台灣防衛決心

- 藍黨團批選前承諾跳票:卓榮泰、賴清德勿成三班護病比絆腳石

- 有夠荒謬!俄閱兵日請烏軍停火 軍事專家揭烏方超猛無人機「飛1700公里直搗敵境」:不對稱戰力大發威

- 鄰近淺草寺!日本東京逾50年商店街確定拆除 7月底吹熄燈號

- 除毛診間被爆「裝監視器」客氣炸 聖宜診所3點聲明:提供現金退款

- 認罪繳1.2億元拚交保! 郭哲敏喊:柯文哲、陳歐珀都沒押 高院第5度打臉

- 日本琵琶湖一天發現三具浮屍! 有男有女警方調查中

- 波灣又有貨輪遇襲 伊朗放話:制裁國船隻別想通過荷姆茲海峽

- 漢他病毒郵輪靠岸!乘客今下船 多國派專機赴西班牙接人

- 許宇甄揭中央聯辦北棟管理費亂漲價:難怪百姓苦哈哈

「養龍蝦」衍伸資安疑慮? 數發部資安署提3風險5做法

2026-03-25 14:46 / 作者 戴嘉芬

針對AI代理平台衍伸的資安疑慮,數發部資安署提出3大威脅情境。數發部提供

俗稱龍蝦的AI代理平台OpenClaw近日在全球爆紅,與生成式AI相比,AI Agent具備自主執行能力,可能引發相關資安疑慮。數位發展部資安署今日(3/25)表示,此類工具具備極高的系統權限與24小時自主運作特性,若未妥善設定防護機制,極易成為駭客入侵個人主機與企業網路的破口,可能導致使用者個資、機敏資訊如帳號密碼及金融資料等外洩,引發身分冒用與財產損失風險。提醒使用者導入OpenClaw時,應落實資安防護與環境隔離。資安署提醒,導入相關工具的單位與民眾,AI 代理的資安風險並非單一漏洞問題,而是涉及架構層面的系統性風險。例如近期Oasis Security的研究人員揭露的ClawJacked漏洞,攻擊者僅需誘導使用者瀏覽惡意網頁,就能在不觸發瀏覽器安全警報的情況下,對AI代理的管理員權限進行暴力破解。

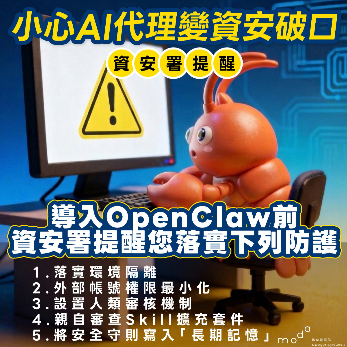

在評估AI代理工具的風險時,應特別注意以下幾類資安威脅情境:

1. 惡意指令可能出現在外部網頁: AI代理在瀏覽外部網頁或讀取真實世界的社群留言時,若內容中暗藏攻擊者預埋的惡意指令, AI代理有可能執行刪除檔案、竄改系統設定等危險操作。

2. 第三方技能包暗藏惡意程式: AI代理可以安裝名為「技能(Skill)」的擴充來執行訂票、製作影片等複雜任務。網路上已有開放平台供使用者分享自製的擴充包,攻擊者可將惡意行為指令寫入其中並偽裝成正常的Skill上架,一旦安裝即可能被植入後門或惡意程式。

3. 長時間運作導致安全守則遺失: AI 代理能處理的資訊量有限,長時間運作後會自動壓縮早期內容以騰出空間。在此過程中,原本設定好的安全規則與權限設置可能被刪減,導致AI代理逐漸「忘記」哪些事不該做,產生失控行為。

資安署建議,各界在評估與導入此類新型的AI代理工具時,應提高警覺並落實下列實務措施:

1. 落實環境隔離: 避免將AI代理安裝於存放機密資料或日常作業的環境。應將其部署於全新、已格式化的獨立電腦,或是專屬的虛擬機(Virtual Machine)或容器(Container)中,以此進行有效的風險管控。

2. 外部帳號權限最小化: 為AI代理註冊專屬的獨立帳號(包含專用電子郵件及社群平台帳號),避免將個人日常使用的帳號與密碼直接提供給AI代理。若AI代理必須登入外部服務,建議設定具有時效性的臨時授權憑證,時間一到權限即自動失效,避免日後因疏於管理而導致帳號遭竊。

3. 設置人類審核機制: 針對高風險操作(如存取憑證、發送郵件或執行系統指令),應於系統設定中強制啟用人工審核,要求每次執行前必須經由人員手動確認方可放行。

4. 親自審查Skill擴充套件: 在安裝任何第三方技能擴充套件前,應先對其內容說明與程式碼進行完整的安全掃描。若發現內容中有要求下載不明檔案、連線至不明網站等可疑行為,應立即停止安裝並向平台檢舉,同時企業用戶應於組織內部進行資安通報。

5. 將安全守則寫入「長期記憶」: 定期審閱且備份AI的長期記憶檔。務必將重要的安全限制(例如:刪除郵件前必須經過人員同意)直接寫入「核心記憶檔案」(如:OpenClaw的MEMORY.md)中,確保每次運作時都會強制載入安全守則,避免因記憶壓縮而遺忘設定好的防護設定。

數發部資安署提出5項實際做法,讓民眾落實防護。數發部提供

資安署強調,AI代理技術能帶來顯著的創新效益,但須在「環境隔離」、「人工審核」的前提下進行測試與應用,方能兼顧數位發展與資訊安全。

最新more>

- 川習會MSCI季調登場 台股四萬二壓力測試、進入高檔整理

- 逾10萬公里折返跑 史國副總理杜札莉昨飛第四趟離台

- 為川習會暖身 美中財經首長週三將在南韓會晤

- 【懶人包】恐怖郵輪3死!漢他奪命時間軸曝光 罕見「人傳人」病毒致命達5成

- 「不存在適用所有人的理想揮棒」藍鳥打教鼓勵勇敢揮棒造就現在的岡本和真

- 誠品南西店傳「鼠出沒」 北市府晚間聯合稽查發現空汙防制設備有油煙逸散

- 普發現金2.0?羅明才提案:每人給1萬元「國民支援金」 草案進度曝光

- 印尼在唐人街旁破獲史上最大非法網路賭博組織 逮捕逾300名外籍人士

- 北市知名產後護理之家疑涉裝偷拍設備 負責人喊冤:無功能廢線

- 偷拍連環爆!達人教自保6大招 「靠手機就能查」免下載APP

熱門more>

- 愛爾麗→光澤診所!針孔偷拍「她」發現的 扮柯南「以圖搜圖」蒐證始末一次看

- 快遞禮物竟變惡魔!FedEx司機綁架勒殺7歲女童 「她哭喊錄音曝光」家人心碎

- 21歲啦啦隊美眉淪詐騙車手!「曾為12強應援」 收錢3次下場曝

- 碩士生校門口創作意淫學生 台南女中火大提告

- 台灣看過來!烏克蘭擁2利器源頭打擊 沒有愛國者飛彈也能制敵

- 塞揚獎、年度MVP很難全都要?大谷獨一無二身分恐掀口水戰

- 安檢太慢航班照飛!乘客氣得衝出「人肉擋機」 失控場面曝光

- YG混血練習生19歲離世!曾被看好進BABYMONSTER 韓網瘋傳死訊

- 悚!清大台積館女學生墜樓亡

- 一月賠掉一年!勞動基金單月虧損寫下歷史紀錄 新制勞退分紅縮水至2.2萬